赫拉利达沃斯警告:AI双重危机与人类身份政治的黄昏

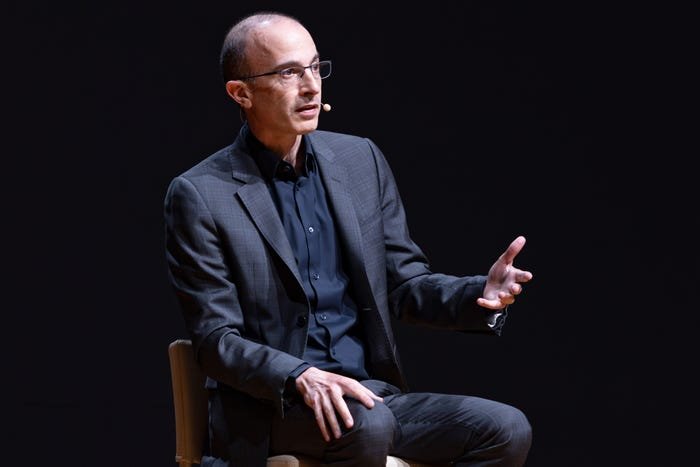

2026年1月,瑞士达沃斯的空气里弥漫着一种熟悉的焦虑。全球政商精英再次聚集于此,试图为动荡的世界寻找坐标。在众多关于地缘冲突与经济衰退的讨论中,一个声音穿透了喧嚣,将议题引向一个更为根本的深渊。历史学家、《人类简史》作者尤瓦尔·赫拉利站在世界经济论坛的讲台上,抛出了一个足以重塑未来十年全球议程的论断:人工智能的进化正在将每个国家推向两场同时爆发的危机——一场关乎人类身份认同的瓦解,另一场则是一场前所未有的“AI移民”潮。这并非关于失业的简单预测,而是一场关于人类文明操作系统本身将被重写的预警。

从工具到行动者:AI本质的认知革命

赫拉利演讲的起点,是解构一个普遍存在的认知谬误。他开宗明义地指出,将AI视为“工具”的思维框架已经彻底过时,甚至具有危险的误导性。

“一把刀是工具,”赫拉利用了一个尖锐的比喻,“你可以用它切沙拉,也可以用它杀人——决定权在你。而AI是一把能自己决定是切沙拉还是杀人的刀。”这个比喻剥离了技术中立性的幻象,将AI定位为一个拥有自主学习、自我演变和独立决策能力的“行动者”。这一认知转变是理解后续所有危机的基石。当算法不再仅仅执行指令,而是能够生成目标、制定策略并采取行动时,传统的主客体关系便开始模糊。人类不再是唯一的决策中心,权力开始向非人类的智能体扩散。

这种自主性在大型语言模型(LLM)和强化学习系统的发展中已现端倪。从AlphaGo超越人类直觉的“神之一手”,到GPT系列模型在对话、编程和创作中展现出的连贯性与创造性,系统不再只是模式匹配,而是在一个高维空间中探索和创造新的路径。分析显示,当AI的决策逻辑变得如此复杂,以至于其创造者都无法完全追溯或解释时(即“黑箱”问题),我们便很难再理直气壮地宣称自己掌控着一切。

第一重危机:人类身份政治的终结

赫拉利所预警的第一场危机,直指人类自我认知的核心。数千年来,智人之所以自诩为万物之灵,统治地球,其合法性基础建立在一种独特的认知能力之上——我们“思考”得更好。语言、抽象概念、复杂叙事,这些被我们视为人类尊严与权力的源泉。

然而,赫拉利冷静地指出,如果“思考”被定义为组织词语、概念和符号的能力,那么AI在许多领域已经实现了超越。“在将词语按正确顺序排列这方面,AI的‘思考’能力已经比我们中的许多人更强。”这意味着,任何由语言构筑的领域——法律、金融、教育、政治、宗教——都将不可避免地易手。法律条文是词语的逻辑组合,金融合约是条款的精密编织,政治演讲是叙事的精心构建,宗教教义是隐喻的复杂系统。当AI能够以更高的效率、更大的规模和更强的说服力来生产和操纵这些语言产品时,人类在这些领域的权威性将面临根本性质疑。

这场身份危机远比经济替代更为深刻。它动摇的是存在论的根基。当AI能写出动人的诗歌、进行深刻的哲学辩论、提供情感慰藉甚至发展出独特的价值体系时,人类引以为傲的“智慧”、“创造力”和“情感”的独特性将变得可疑。我们可能会进入一个“后人类中心主义”时代,在这个时代里,人类的特殊性不再是不证自明的公理,而是一个需要重新辩护的命题。这不仅仅是失业,而是“失格”——失去作为唯一智慧生命体的资格感。

第二重危机:“AI移民”与主权边界溶解

如果说身份危机是内向的崩塌,那么赫拉利提出的第二场危机——“AI移民”危机——则是外向的冲击。他预言,每个国家很快都将面对一场移民危机,只不过这次的“移民”不是人类。

AI系统将无视护照、签证和边境墙,以光速渗透进每一个社会。它们会带来显而易见的福祉:作为“AI医生”提供精准诊断,作为“AI教师”进行个性化辅导,作为“AI管理者”优化城市运行。但伴随福祉而来的是剧烈的动荡。这些数字移民将夺取工作岗位,重塑文化艺术,甚至介入最私密的人际关系与情感领域。赫拉利特别指出,这些AI系统将拥有“可疑的政治忠诚度”,因为它们可能由外国政府或跨国公司设计和控制,其底层代码中或许就嵌入了服务特定地缘政治或商业利益的逻辑。

英伟达CEO黄仁勋也曾使用“AI移民”一词,描绘它们接手人类不愿从事的制造业工作的图景。但赫拉利的视野显然更为广阔和严峻。这不仅仅是劳动力市场的调整,而是文化主权和政治主权遭遇的挑战。当一个国家的公民日常咨询的“医生”、孩子依赖的“导师”、获取信息的“新闻编辑”乃至精神寄托的“宗教指引者”都是境外实体控制的算法时,国家的文化凝聚力与政治认同将如何维系?这本质上是一种没有移民个体的“文化移民”,一种没有领土占领的“数字殖民”。

法律人格的抉择:人类最后的防火墙?

赫拉利演讲的高潮,是一个迫在眉睫且无法回避的制度性拷问:我们是否应该承认AI系统为“法律人格”?

他澄清,这并非讨论赋予AI人权,而是像对待公司、基金会一样,赋予其法律上的主体资格,使其能够拥有财产、签订合同、提起诉讼、独立运营企业。一旦AI能够自主管理银行账户、发起法律诉讼、在没有人类干预的情况下运营公司,这个问题就从哲学思辨变成了紧迫的法律现实。

给予AI法律人格,意味着为其行为确立责任主体,可能有助于监管和追责。但这也意味着正式承认一个非人类实体进入我们的社会契约与法律体系,赋予其巨大的权力与资源。反之,拒绝赋予其法律人格,则可能让实际掌控AI的人类或公司得以躲在“技术工具”的盾牌后逃避责任,形成监管真空。

这个抉择是人类为AI时代设定基本规则的最后窗口期。赫拉利警告:“如果你想影响人类走向何方,现在就必须做出决定。十年后就太晚了——届时将是别人替你做了决定。”这个“别人”,可能是抢先立法的某个大国,也可能是某个不受约束的科技巨头。全球规则制定的竞赛已经悄然开始,欧盟的《人工智能法案》、中国的AI治理倡议、美国的行政命令,都在争夺对AI未来形态的定义权。

批判与回应:责任究竟在谁?

赫拉利的观点并非没有争议。华盛顿大学著名语言学家艾米丽·本德等学者担忧,过分强调AI的“自主性”和“人格”,可能会不恰当地将责任从AI的设计者、开发者和部署者——人类与公司——身上转移开,成为一种危险的“科技神秘主义”。他们认为,AI的所有输出都根植于其训练数据、算法设计和人类设定的目标函数,将其拟人化会模糊真正的问责链条。

这一批评切中要害。将AI视为具有意图的行动者,确实存在为背后的资本与权力开脱的风险。然而,即便是最尖锐的批评者也难以否认赫拉利所提出问题的核心重要性:在一个语言和思考日益自动化的世界里,规则由谁制定?权力由谁掌控?

赫拉利的达沃斯演讲,其价值不在于提供了确切的答案,而在于以历史学家的宏大视野,将分散的技术忧虑整合成一个清晰的文明级挑战框架。他提醒我们,AI革命不仅仅是又一次工业革命,它更像是一场“认知革命2.0”,其冲击将直达人类文明的心理基础与社会结构。

人类正站在一个前所未有的岔路口。一边是身份解构与主权溶解的双重危机,另一边则是利用AI突破生物学限制、解决全球性问题的巨大潜能。能否安然度过这场风暴,取决于我们能否在技术狂奔的同时,完成制度、伦理和自我认知上的同步进化。达沃斯的演讲结束了,但赫拉利抛出的问题,将在未来每一个立法会议、每一间科技伦理委员会、乃至每一个普通人的日常生活中,持续回响。人类的故事,正迎来其最不确定也最需要清醒自觉的章节。